A aprovação do Projeto de Lei 21/20 (conhecido como Marco Legal da Inteligência Artificial) é aguardada com bastante expectativa e entusiasmo, já que pode representar diversos avanços para a transformação digital no país.

Mas, mesmo que haja anseio por esse desdobramento, a decisão no início de julho de aprovar o regime de urgência pela Câmara dos Deputados e levar o projeto direto ao plenário sem ter relatório para discussão foi motivo de crítica de movimentos e entidades setoriais.

Isso porque ao estabelecer princípios, direitos e deveres para o uso da tecnologia no Brasil, a proposta configura uma oportunidade valiosa de desenvolvimento para o país. E da mesma maneira que aconteceu com o Marco Civil da Internet e a Lei Geral de Proteção de Dados Pessoais (LGPD), deve ser amplamente debatida e tratada com atenção e cuidado.

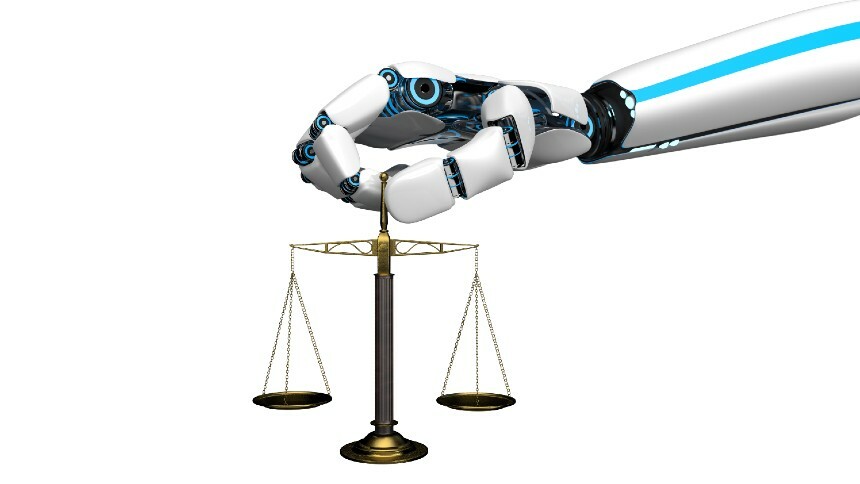

Acelerar ou até pular etapas nesse debate é preocupante, já que existem vários desdobramentos a serem analisados e ponderados. Afinal, um dos grandes desafios da área é conseguir atingir formatos que nivelem a autonomia necessária para explorar as inovações e benefícios da Inteligência Artificial (IA) com a supervisão humana voltada para mitigar riscos.

Em países como a Alemanha e a China, onde o setor automotivo já possui tecnologias bem estabelecidas, a legislação discute a circulação de veículos sem motorista, referente ao nível quatro de automação no segmento. O ideal é conseguir elaborar uma redação que não seja restritiva, mas que leve em conta ameaças que podem surgir com sua aplicação na sociedade.

Com o uso cada vez mais frequente da IA por todo mundo, é fundamental reforçar a segurança jurídica na área, de modo que as regras não se tornem entraves que atrasem seu desenvolvimento. Até pela complexidade do tema, as análises e reflexões são indispensáveis para tentar chegar num modelo ético, equilibrado e transparente sobre quais princípios e normas devem nortear suas aplicações, para evitar desde abusos privacidade até algoritmos preconceituosos.

A LGPD, por exemplo, já prevê em seu artigo 20 a possibilidade de um titular pedir revisão de uma decisão automatizada. Assim como exige no artigo 6 que o tratamento de dados pessoais cumpra princípios de transparência e não discriminação. Mas a questão vai além da proteção de dados pessoais, está relacionada com como vamos melhor integrar o uso da IA e evitar os efeitos colaterais de eventuais vieses da tecnologia.

Como aprofundar os debates sobre direitos e obrigações? Fato é que o PL 21/20 impacta a realidade social e econômica do país em diferentes setores. Mesmo que ainda não haja consenso na indústria e na academia, o Brasil precisa estar preparado e ter uma política pública que apoie e estimule a corrida robótica.

Enquanto isso o uso da IA avança no mundo. Alguns países e blocos que lideram o uso da tecnologia (como Estados Unidos, China, Rússia e União Europeia) abordam seu desenvolvimento e regulamentação de maneiras distintas - que variam também conforme as permissões de acessos aos dados pessoais. Logo, essas diferenças têm impacto direto em questões de política de segurança e privacidade.

A abordagem da UE tem sido mais conservadora, com uma classificação recente sobre o que seria uma IA de alto risco e diretrizes que colocam a proteção de dados e a segurança civil em primeiro plano. Enquanto os EUA, a China e a Rússia se concentram nos avanços militares e nos aspectos financeiros competitivos globais. De disputa tecnológica, enfrentamos também uma disputa regulatória e ideológica.

Na minha visão, deveríamos levar o debate para nível global, a partir de regras sobre ética, segurança e transparência regidas por um Tratado Internacional

Na minha visão, deveríamos levar o debate para nível global, a partir de regras sobre ética, segurança e transparência regidas por um Tratado Internacional. A crescente dependência de algoritmos para analisar as informações, com o intuito de tomar as melhores decisões, envolve questões urgentes de responsabilidade e de respeito pelos direitos humanos.

Ainda não sabemos se é possível criar um conjunto de dados plural e complexo o suficiente para representar e entender toda a diversidade humana. Como é difícil alcançar essa abrangência, os sistemas reproduzem desequilíbrios e vieses encontrados nas informações originais, sendo tendenciosos para determinados resultados e podendo influenciar experiências de maneira negativa.

Por isso que a transparência é indispensável para atingir a Ética de Dados em projetos que envolvam o uso de algoritmos e tudo o que estiver relacionado às decisões pela Inteligência Artificial (IA), aprendizado de máquina e robôs. Essa era de convivência tecnológica já chegou. Assim como a necessidade de revisões e atualizações para evitar vieses discriminatórios. A ideia é manter uma boa reputação de dados, determinante para definir estratégias futuras, em informações programadas que gerem mais valor do que danos.

Patricia Peck é advogada especialista em Direito Digital com 22 anos de atuação. Graduada e doutorada pela Universidade de São Paulo. Embaixadora Smart IP Latin América pelo Max Planck para o Brasil. Presidente da Comissão Especial de Privacidade e Proteção de Dados da OAB/SP. CEO e sócia-fundadora do Peck Advogados. Programadora desde os 13 anos. Autora de 32 livros de Direito Digital