Alguns anos atrás, pesquisadores da Universidade de Iowa nos EUA fizeram um experimento interessante: treinaram pombos para reconhecer imagens de câncer de mama. Quando acertavam, eram premiados com milhos. O resultado foi que depois de algum tempo, os pombos, que tem uma acuidade visual muito superior à dos humanos, passaram a ter assertividade maior que os radiologistas.

Isso significa que podemos substituir radiologistas por um pombal? Claro que não. Os pombos não tinham a menor ideia do que estavam fazendo. Não sabiam o que é câncer de mama e nem seu impacto na vida das pessoas. Os radiologistas sabem.

É a mesma coisa com algoritmos de redes neurais. O termo sugere que esses algoritmos replicam as redes neurais dos nossos cérebros. Não é verdade. Nós ainda não compreendemos como o cérebro usa seus neurônios, e, portanto, não podemos simulá-los em computadores.

As redes neurais artificiais não funcionam da maneira de nossos cérebros. Na verdade, são similares a maneira como os coeficientes são estimados em modelos de regressão, descobrindo valores para os quais as predições do modelo são mais próximas dos valores observados, sem compreender o que está sendo modelado.

São muito úteis, mas chamar essas fórmulas matemáticas de “inteligência artificial” é um exagero. Não são inteligentes, não entendem o que estão fazendo. Não sabem o que estão manipulando. Não replicam a maneira como os humanos pensam. São como os pombos.

Esse é o desafio de aplicação da IA em setores críticos, como na saúde. Existe um potencial enorme, mas a jornada é muito mais longa e árdua que muitos imaginavam no início. Uma olhada nos EUA mostra que mesmo em práticas clinicas que apareciam extremamente promissores, como na radiologia, apesar de já existirem dezenas de algoritmos aprovados pelo FDA, a Anvisa de lá, apenas uma pequena parcela está realmente em uso.

O artigo “AI has a long way to go before doctors can trust it with your life” mostra que um dos principais problemas é a inconsistência dos resultados. Apenas 5,7% dos radiologistas que usaram algoritmos de IA reportaram que seus sistemas sempre funcionam, enquanto 94% classificaram seus resultados como erráticos.

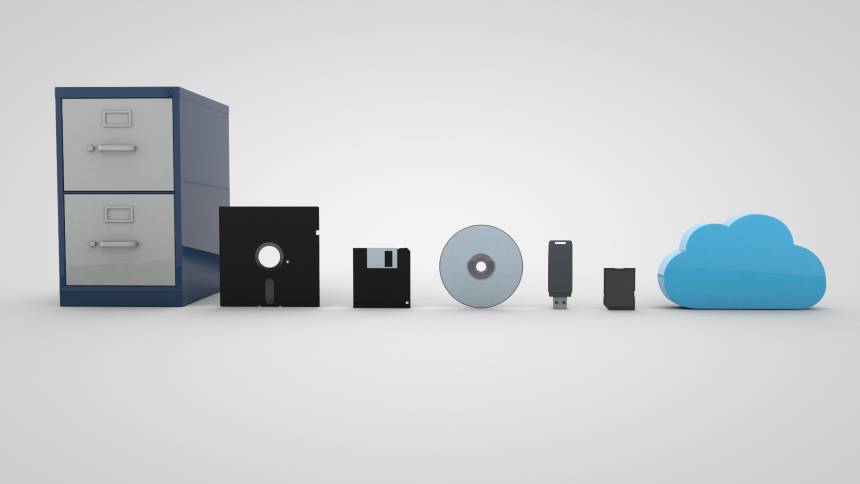

Na prática, aprendemos que treinar e testar um modelo em laboratório é bem diferente de colocá-lo em produção. Imaginou-se que seria relativamente fácil fazer com que os algoritmos analisassem imagens com precisão.

Na verdade, eles fazem isso, mas sua assertividade depende das imagens de treinamento e quando saem de um ambiente de testes, com imagens de alta qualidade, e caem no mundo real, com imagens menos nítidas e protocolos diferentes dos quais aprendeu, sua taxa de acerto cai significativamente.

O mundo real é bem diferente do mundo fechado e esterilizado nos quais os algoritmos tendem a ser treinados. Em alguns casos, como nos sistemas para controle de veículos autônomos, encontramos o fenômeno da cauda longa, aquelas situações que ocorrem de forma dispersa, mas que causam problemas sérios, inclusive provocando acidentes.

O trânsito é um cenário em que as situações insólitas e inesperadas acontecem com frequência, mas que são difíceis de serem replicados em dados de treinamento. Por isso, ocorrem acidentes, como os que ocorreram com os veículos da Tesla e que agora estão sendo investigados, como vemos no artigo “U.S. Will Investigate Tesla’s Autopilot System Over Crashes With Emergency Vehicles”.

Os veículos não reconheceram como obstáculos caminhões de bombeiros ou ambulâncias, parados nas estradas, com suas luzes estroboscópicas piscando. O princípio básico de funcionamento dessas luzes é o acende e apaga e isso confundiu os algoritmos dos veículos.

Um estudo bem instigante, “Why deep-learning AIs are so easy to fool”, mostra o efeito do fato dos algoritmos de rede neural não entenderem realmente o mundo, pois são estruturas de software compostas por fórmulas matemáticas interconectadas.

Por não disporem de bom senso e nem aprenderem com a experiência de viver no mundo real, como nós humanos, erram de forma grosseira em situações que nós facilmente reconhecemos e nos saímos bem.

Os algoritmos de IA são modelos que criam representações matemáticas de pixels. São treinados “vendo” milhares e milhares de imagens de carros que estejam rotulados como “carros”. Quando recebe uma nova foto de carro, ele tenta fazer o casamento matemático com os modelos de pixels que já “aprendeu”.

Quando dá match ele aponta que é um carro. Se não der match, ele aponta o que mais se aproxima estatisticamente, que pode ser algo como uma tampa de lixeira. Esse é outro aspecto da IA: ela não tem bom senso e, portanto, o que causar match ele indica como resposta, por mais esdrúxulo que seja.

Não esqueçam que o algoritmo não tem a mínima ideia do que seja um carro. Ele apenas responde baseado no que foi rotulado. Se, por acaso, todas as imagens de carro fossem rotuladas como gatos, ele apontaria, no caso de match, que as imagens seriam gatos

Esse é um aspecto perturbador na aplicação da IA em saúde. O estudo “Adversarial attacks on medical machine learning” publicado pelo NCBI (National Center for Biotechnology Information) americano exemplifica situações em que erros podem ocorrer por simples falhas no registro de alguns poucos pixels em imagens médicas. Às vezes, um simples pixel derruba o algoritmo.

Incrível, mas o artigo “AI image recognition fooled by single pixel change” mostra situações em que um único pixel foi alterado e o resultado foi desastroso. Bem, não esqueçamos que IA não é inteligente e nem tem bom senso e assim, quando um único pixel altera seu padrão de reconhecimento, ela responde com o padrão que mais se assemelhar, por mais incoerente que pareça para nós.

O que estamos aprendendo é que a maioria dos desafios da IA não são aplicações técnicas da IA. Já existe um grande número de algoritmos. No entanto, a maioria de sua validação e implementação na prática médica é prejudicada pela dificuldade de acesso a grandes conjuntos de dados de alta qualidade.

Além disso, os sistemas de IA não operam no vácuo, precisando ser integrados aos demais sistemas de um hospital. Assim, para apoiar a parte diagnóstica do trabalho dos radiologistas, os desenvolvedores dos sistemas de IA precisam criar, treinar, testar, buscar autorização do FDA (no caso dos EUA) para distribuir, apoiar e atualizar milhares de algoritmos.

E as organizações de saúde e os médicos precisariam encontrar, avaliar, comprar e implantar vários algoritmos de muitos desenvolvedores e, em seguida, incorporá-los aos fluxos de trabalho existentes.

Para agravar o desafio, a demanda por dados dos modelos de DL (Deep Learning) está voraz. A maioria dos modelos foi desenvolvida em configurações controladas usando conjuntos de dados disponíveis, e muitas vezes limitados, e sabemos que os resultados que os algoritmos produzem são tão robustos quanto os dados usados para criá-los.

Os modelos de IA podem ser frágeis, funcionando bem com dados do ambiente no qual foram desenvolvidos, mas erráticos ou incoerentes quando aplicados a dados gerados em outros locais com diferentes populações de pacientes, máquinas de imagem e técnicas.

A área de saúde tem extrema criticidade, pois lida diretamente com a vida das pessoas e é extremamente regulada. Assim, muitas vezes, mesmo grandes empresas de tecnologia criam ambições demasiado grandes e falham. Foi assim com IBM (Why IBM Watson Health could never live up to the promises), Apple (Apple Struggles in Push to Make Healthcare Its Greatest Legacy) e Google (Google Dismantling Health Division). Todas essas empresas estão pivotando suas ideias iniciais, ambiciosas demais, e se concentrando no que fazem melhor, vender dispositivos e dados para uso pessoal.

Isso significa que IA não será aplicada a área de saúde? De maneira nenhuma. O interesse é imenso e um recente relatório mostrou que existem cerca de 350 mil apps relacionados com saúde (Digital health app market booming, finds IQVIA report), com 90 mil lançados ano passado, a um ritmo de 250 apps por dia.

Claro que a imensa maioria não vai sobreviver, mas isso demonstra o gigantesco interesse pelo uso de IA e tecnologias digitais no setor. Ano passado também escrevi um estudo sobre aplicação de IA em saúde, disponível para download gratuitamente. O estudo “O impacto da inteligência artificial no setor de saúde” pode ser baixado aqui.

Em resumo, a IA em saúde é uma furada? Absolutamente. Sigo entusiasta, mas precisamos ser realistas e buscar sua evolução sem modismos ou hype. Enfrentar os desafios da sua evolução (estamos engatinhando), formar talentos de forma adequada e não de forma amadorística, com cursos de “aprenda tudo sobre IA em uma semana”, e principalmente ser coerente nas propostas de projetos onde IA será aplicável. IA não é solução pata todos nossos problemas. Recomendo o artigo da Scientific American, “AI Isn’t a Solution to All Our Problems”, para uma visão bem equilibrada de onde e como usar IA de forma adequada.

Mantenho a visão que a IA é uma tecnologia transformadora, como a eletricidade e a própria internet. Em cima dela serão criados novos produtos, serviços e modelos de negócio. E não existe nenhuma inconsistência entre uma visão otimista de longo prazo e as eventuais frustrações que temos no curto prazo. Ambos podem coexistir simultaneamente.

Cezar Taurion é VP de Inovação da CiaTécnica Consulting, e Partner/Head de Digital Transformation da Kick Corporate Ventures. Membro do conselho de inovação de diversas empresas e mentor e investidor em startups de IA. É autor de nove livros que abordam assuntos como Transformação Digital, Inovação, Big Data e Tecnologias Emergentes. Professor convidado da Fundação Dom Cabral, PUC-RJ e PUC-RS